PARIS – Wissenschaftler sagten am Montag, sie hätten einen Weg gefunden, Gehirnscans und künstliche Intelligenzmodelle zu verwenden, um „das Wesentliche“ dessen, was die Menschen denken, in einem Schritt in Richtung Gedankenlesen zu transkribieren.

Während das Hauptziel des Sprachdecoders darin besteht, Menschen zu helfen, die die Fähigkeit zur Kommunikation verloren haben, räumten die US-Wissenschaftler ein, dass die Technologie Fragen zur „mentalen Privatsphäre“ aufwirft.

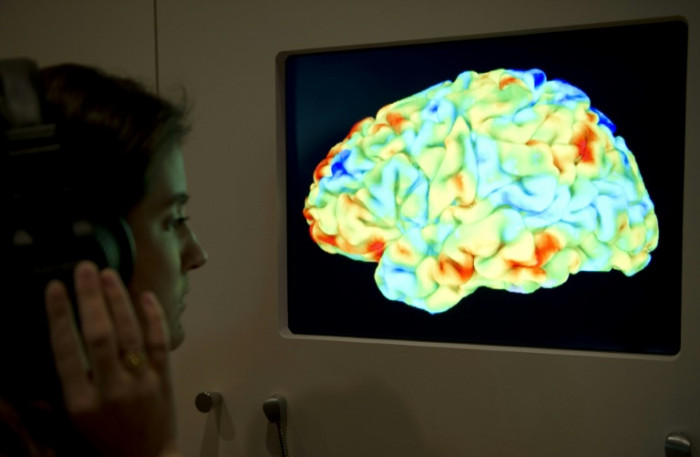

Um solche Befürchtungen zu zerstreuen, führten sie Tests durch, die zeigten, dass ihr Decoder nicht bei jemandem verwendet werden konnte, der nicht zugelassen hatte, dass er über lange Stunden in einem funktionellen Magnetresonanztomographen (fMRI) auf ihre Gehirnaktivität trainiert wurde.

Frühere Forschungen haben gezeigt, dass ein Gehirnimplantat Menschen, die nicht mehr sprechen oder tippen können, ermöglichen kann, Wörter oder sogar Sätze zu buchstabieren.

Diese „Gehirn-Computer-Schnittstellen“ konzentrieren sich auf den Teil des Gehirns, der den Mund steuert, wenn er versucht, Wörter zu bilden.

Alexander Huth, Neurowissenschaftler an der University of Texas at Austin und Co-Autor einer neuen Studie, sagte, dass der Sprachdecoder seines Teams „auf einer ganz anderen Ebene arbeitet“.

„Unser System funktioniert wirklich auf der Ebene der Ideen, der Semantik, der Bedeutung“, sagte Huth auf einer Online-Pressekonferenz.

Laut der Studie in der Fachzeitschrift Nature Neuroscience ist es das erste System, das in der Lage ist, kontinuierliche Sprache ohne ein invasives Gehirnimplantat zu rekonstruieren.

– ‚Tiefer als Sprache‘ –

Für die Studie verbrachten drei Personen insgesamt 16 Stunden in einem fMRT-Gerät und hörten sich gesprochene Geschichten an, hauptsächlich Podcasts wie Modern Love der New York Times.

Auf diese Weise konnten die Forscher herausfinden, wie Wörter, Phrasen und Bedeutungen Reaktionen in den Regionen des Gehirns hervorrufen, die dafür bekannt sind, Sprache zu verarbeiten.

Sie speisten diese Daten in ein neuronales Netzwerk-Sprachmodell, das GPT-1 verwendet, den Vorgänger der KI-Technologie, die später im äußerst beliebten ChatGPT eingesetzt wurde.

Das Modell wurde darauf trainiert, vorherzusagen, wie das Gehirn jeder Person auf die wahrgenommene Sprache reagieren würde, und dann die Optionen einzugrenzen, bis es die nächste Antwort gefunden hat.

Um die Genauigkeit des Modells zu testen, hörte sich jeder Teilnehmer dann eine neue Geschichte im fMRI-Gerät an.

Der Erstautor der Studie, Jerry Tang, sagte, der Decoder könne „das Wesentliche dessen, was der Benutzer hörte, wiederherstellen“.

Als die Teilnehmerin beispielsweise den Satz „Ich habe noch keinen Führerschein“ hörte, kam das Model zurück mit „sie hat noch nicht einmal angefangen, Autofahren zu lernen“.

Der Decoder habe mit Personalpronomen wie „ich“ oder „sie“ zu kämpfen, räumten die Forscher ein.

Aber selbst wenn sich die Teilnehmer ihre eigenen Geschichten ausdachten – oder Stummfilme ansahen – sei der Decoder immer noch in der Lage, das „Wesentliche“ zu erfassen, sagten sie.

Dies zeige, dass „wir etwas entschlüsseln, das tiefer ist als Sprache, und es dann in Sprache umwandeln“, sagte Huth.

Da das fMRI-Scannen zu langsam ist, um einzelne Wörter zu erfassen, sammelt es einen „Mischmasch, eine Anhäufung von Informationen über wenige Sekunden“, sagte Huth.

„So können wir sehen, wie sich die Idee entwickelt, auch wenn die genauen Worte verloren gehen.“

– Ethische Warnung –

David Rodriguez-Arias Vailhen, ein Bioethik-Professor an der spanischen Universität Granada, der nicht an der Forschung beteiligt war, sagte, es gehe über das hinaus, was durch frühere Gehirn-Computer-Schnittstellen erreicht worden sei.

Dies bringt uns einer Zukunft näher, in der Maschinen „Gedanken lesen und Gedanken transkribieren“ können, sagte er und warnte davor, dass dies möglicherweise gegen den Willen der Menschen geschehen könnte, beispielsweise wenn sie schlafen.

Die Forscher erwarteten solche Bedenken.

Sie führten Tests durch, die zeigten, dass der Decoder bei einer Person nicht funktionierte, wenn er nicht bereits auf ihre eigene spezielle Gehirnaktivität trainiert worden war.

Auch den Decoder konnten die drei Teilnehmer problemlos vereiteln.

Beim Hören eines der Podcasts wurden die Nutzer aufgefordert, bis Siebener zu zählen, Tiere zu benennen und sich vorzustellen oder sich eine andere Geschichte in Gedanken zu erzählen. All diese Taktiken „sabotierten“ den Decoder, sagten die Forscher.

Als nächstes hofft das Team, den Prozess zu beschleunigen, damit sie die Gehirnscans in Echtzeit entschlüsseln können.

Sie forderten auch Regelungen zum Schutz der geistigen Privatsphäre.

„Unser Verstand war bisher der Wächter unserer Privatsphäre“, sagte der Bioethiker Rodriguez-Arias Vailhen.

„Diese Entdeckung könnte ein erster Schritt sein, um diese Freiheit in Zukunft zu gefährden.“